-

光学3维成像技术在医疗美容、工业领域、文物保护和许多其它领域有非常广泛的应用[1-3],获取真实世界中场景的深度图或点云数据对之后的模型数字化和可视化越来越重要。然而实际中场景杂乱多变,被测物体表面形貌复杂,传统的光学3维成像技术常常由于遮挡问题而无法单次扫描获取完整的数据,例如镂空工艺的艺术收藏品、具有保护栅栏的风机等特定的场景下,传统的光学3维成像技术很难在不改变被测物体原有状态下方便地对其3维成像,而改变被测物体原有状态往往会带来额外的风险和成本。近年来,因光场3维成像技术在解决阴影、高光和遮挡等问题中有突出的优势,受到了国内外学者的广泛关注。光场数据记录了空间中光线的位置信息和方向信息,通过分析视差信息或焦点堆栈的合焦信息可以获得场景的深度信息。LIU等人[4]提出了一种子孔径图像对选择和立体匹配算法用于视差计算,然后使用图割全局优化算法获取精确的深度图。TAO等人[5-6]基于焦点堆栈原理使用数字重聚焦技术来获得一系列不同深度的聚焦堆栈图像,并结合散焦线索和对应线索来估计场景的深度。ZHOU等人[7]利用光场的多方向对极几何,提出了一种无监督的深度估计神经网络,在没有任何真实标签的情况下从光场的中心视图估计场景的深度信息。然而上述研究中的被动式光场3维成像方法依赖场景的纹理、色彩和灰度等场景自身特征,难以准确地恢复出一般场景的3维数据。针对这些问题,有人提出了主动式光场3维成像方法。CAI等人[8-9]结合光场成像和结构光技术,通过标定投影设备与光场相机的三角关系[10],基于射线标定和相位-深度映射的方法实现了结构光场的3维测量。WU等人[11]通过相位一致性代替辐射度一致性提供了稳健的匹配特征,实现了较高精度的3维测量。但上述主动式方法没有基于光场相机本身的深度线索进行分析,导致了阴影问题,造成了3维数据的丢失,或者未充分利用光场结构本身特有的连续性,需要对条纹图像进行编码,增加了工作中的成本。

基于上述情况,本文作者提出了一种基于霍夫变换的结构光场3维成像方法。实验中利用一幅多线结构光图像对被测物体表面标记特征,通过等间隔水平移动单相机采集光场数据。针对该系统中的图像处理问题,分析霍夫参数空间中投票分布,设计了自适应范围投票和自适应窗口策略,无需对条纹级次编码也能够准确地确定对极平面图像中多根直线的参数,提高了方法计算效率和准确性。实验结果表明,所提方法准确地恢复了被测物体的完整表面形貌,验证了方法的可行性。

-

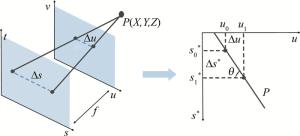

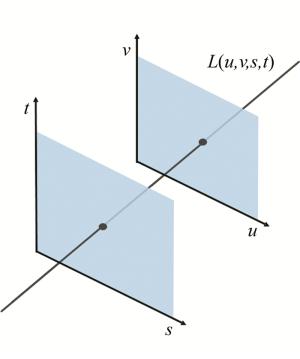

光场的本质是记录了不同方向的光线在空间中独立传播的过程,包含了场景的所有特征信息。为了实现光场数据计算上的高效性、光线的可控和光线的均匀采样,LEVOY等人[12]提出使用双平面法来参数化光场,如图 1所示。图中st平面记录着光线的方向信息,uv平面记录着光线的位置信息,那么一条光线就可以通过连接st平面以及uv平面上两个交点来确定,并用4个参数(u, v, s, t)来描述,而L描述该根光线的辐射度。

对于4维光场L(u, v, s, t),如果固定坐标(v, t)而只对坐标(u, s)进行采样,可以得到一个水平方向的2维切片,该2维切片Lv, t(u, s)是4维光场L(u, v, s, t)的一个子空间,并且BOLLES等人[13]因其特殊的图像结构将这个2维切片称为对极平面图像(epipolar plane image,EPI),它反映了空间中同一物点在不同视角下图像中的视差变化。同样的,也可以通过固定4维光场中的(u, s)坐标,得到竖直方向Lu, s(v, t)的EPI。

4维光场到EPI直线的几何对应关系如图 2所示。任意一个像素的运动轨迹表现为一根直线,这是因为在固定的基线距离下,视差与深度相关,所以EPI中像素点的运动轨迹包含着物点的深度信息。

图 2 4维光场到EPI直线的几何对应关系

Figure 2. Geometric correspondence between the 4-D light field and the line in EPI

根据图 2中4维光场几何对应关系,物点P的深度由下式得出:

$ Z=f \frac{\Delta s}{\Delta u} $

(1) 式中,Δs是两个相机投影中心之间的物理距离,Δu是图像上的视差,焦距f是st平面和uv平面之间的距离。图 2中的水平方向EPI显示了EPI中直线的简化表示,如果将夹角θ定义为EPI直线和u轴之间的角度,则θ和视差Δu之间的关系由下式给出:

$ \tan \theta=\frac{\Delta s^*}{\Delta u} $

(2) 实际上在EPI上计算直线斜率时,s*坐标和u为像素, 单位为pixel。假设像素物理尺寸与两个相邻投影中心间距的比例因子为k,则Δs由下式给出:

$ \Delta s=k \Delta s^* $

(3) 因此, 在进行尺度标定时只需预先知道两个平面的间隔Z,根据(2)式求前平面的tanθ0和后平面的tanθ1, 便可通过下式标定出f:

$ f=\frac{Z}{k\left(\tan \theta_1-\tan \theta_0\right)} $

(4) 考虑到相机镜头畸变带来的图像失真影响,还需进行相机标定,最终空间中物点的3维坐标由下式给出:

$ \left\{\begin{array}{l} Z=f k \tan \theta \\ X=u \frac{Z}{f} \\ Y=v \frac{Z}{f} \end{array}\right. $

(5) 此外,所描述可以直接应用于垂直方向的EPI,只需将固定t和v坐标替换成固定s和u坐标。

-

4维光场数据可以通过相机阵列、微透镜阵列、编码掩模等多种方式获得,各自都有其优缺点,但本质都是获取光线的位置信息和方向信息。在本文中,通过等间隔水平移动单相机来模拟相机阵列采集图像序列,从不同的视角捕捉场景的几何信息,然后将图像序列转换为EPI数据,求解EPI中相应的直线参数得到物体的3维信息。由于平移台本身的平移精度能达到微米级别,相机之间的位置关系可以由平移台移动间距确定,这种采集方式具有高分辨率、成本较低、系统校准简单、相机间串扰小等优点。此外,因被动式光场3维成像技术固有的弊端,在本文的光场3维成像系统中还增加了投影多线结构光的方案,如图 3所示。设计了一个主动式光场3维成像系统,包括单个相机、平移台、投影仪和被测物体。

使用多线结构光投影技术的好处是投影图案的对比度高,相比面结构光方案适用范围更广[14],同时只需投影一幅图案,也不需要与相机做同步采集,整个采集方案简单方便。在光场3维成像系统中,投影仪只起标记被测物体表面特征的作用,位置可以根据需要放置,投影仪的数量也不受限。使用光场成像除了能解决3维测量中的阴影问题之外,还能解决遮挡问题。从图 3中可以看到,如果使用传统的三角测量法,由于遮挡问题,任意单一位置的相机都无法重建出完整的被测物体,被测物体右侧只能由位置L1, L2, L3相机重建,反之同理。最后只有通过系统标定之后,将所有重建数据拼接,才可以重建出完整的被测物体。然而使用光场成像方案,因为每个位置的相机视角有差异,不同视角获取到不同的局部信息,通过EPI融合了所有相机拍摄的图像,补偿了左右侧缺失的数据,只要有两个相机及以上看到同一点,便可以重建出完整的被测物体,而且不需要对相机与相机之间和相机与投影仪之间进行标定,减少了操作的复杂度。

-

根据光场理论将光场的3维成像问题转成在EPI上求解直线斜率的问题之后,有两个经典的方法来解决这个问题,其中最常见的是最小二乘拟合法,它的计算效率非常高,并且在许多情况下提供了高精度的直线参数估计,但最小二乘拟合法不能解决拟合多根直线的情况。另一种经典的方法是使用霍夫变换来拟合直线参数,它的优点是对噪声有很强的抗扰力,同时因为霍夫变换是在全局进行投票提取直线参数,所以它不需要编码方案能够直接拟合多根直线参数。

霍夫变换的基本思想是将图像空间中的一个像素坐标(x, y)通过参数变换到霍夫空间中的一组单元格H(θ, ρ)进行投票累加,参数曲线由下式[15]定义:

$ \rho=x \cos \theta+y \sin \theta $

(6) 式中,ρ表示直线到原点的距离,θ为该直线与正x轴的夹角,对包含直线的图像进行霍夫变换之后,图像中一组共线像素的投票累加值将在霍夫空间中产生一个峰值,该峰值点对应的(θpeak, ρpeak)便是所求的直线参数。值得注意的是, 大部分霍夫变换方法都使用二值化算法对原图进行二值化,然后在二值图上进行霍夫空间投票。然而如果直接对多线结构光图像使用二值化算法会造成精度的损失,这与激光扫描三角法重建时如果直接使用二值化图像也会造成精度损失的情况一致。所以与经典的霍夫变换不同,本方法首先提取EPI条纹的中心坐标[16-17],然后使用亚像素精度的中心坐标进行霍夫投票。

-

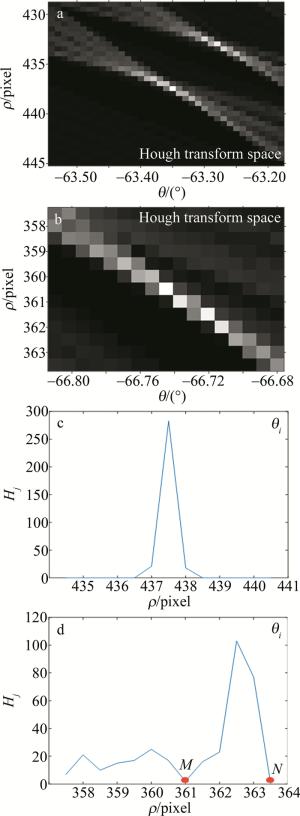

经典的霍夫变换方法在霍夫空间求局部极大值来定位峰值点。然而,由于图像背景噪声、像素之间的干扰、θ和ρ的量化误差、直线厚度等各种不确定性,出现了峰值扩散的现象[18],导致这个峰值在霍夫空间中已经不再清晰可见了,需要一个提取步骤定位准确的峰值参数。在众多改进的霍夫变换方法中,本文中采用XU等人[19]提出的峰值提取算法,该方法基于统计特性分析霍夫空间,通过最小化方差函数求得了较为准确的峰值参数。

对于一个给定大小为w×h的窗口,窗口内某列θi的累加器质心mi和质心方差σi2由下式[19]定义:

$ \left\{\begin{array}{l} m_i=\frac{\sum\limits_j\left(H_{i j} \cdot \rho_j\right)}{\sum\limits_j H_{i j}} \\ \sigma_i^2=\frac{\sum\limits_j\left[H_{i j} \cdot\left(m_i-\rho_j\right)^2\right]}{\sum\limits_j H_{i j}} \end{array}\right. $

(7) 式中,Hij为累加器的值,质心mi为窗口内累加器每列峰值位于“最聚集”的坐标上,而方差σi2用于评估该列累加器的投票聚集程度,即该列越接近峰值,投票聚集程度就越大,方差也就越小,通过对每一列累加器的方差σi2拟合一条2阶多项式曲线,由于该函数是凸函数,通过求导便可最小化拟合函数,得到具有亚像素精度的峰值θpeak。因为质心mi和θi之间的函数关系为一条正弦曲线即(6)式,则可以通过前面得到每列的质心mi拟合该正弦曲线,最后通过下式[19]在θpeak处插值该曲线计算最终的ρpeak:

$ \rho_{\text {peak }}=b_1 \sin \theta_{\text {peak }}+b_0 \cos \theta_{\text {peak }} $

(8) 式中,b1,b0为拟合的参数,最终的直线参数为(θpeak, ρpeak)。

-

在实际场景中,由于被测物体的形状是复杂的,在进行峰值提取时使用固定窗口大小w×h,会造成窗口包含多个峰值,使得质心和方差的计算不准确,导致峰值定位失败,如图 4所示。

图 4a中的情况可以通过缩小窗口解决,但图 4b中的情况即使是缩小窗口也无法准确定位峰值点。为此,设计了一种自适应窗口策略。具体地,从图 4a中可以发现,霍夫空间的峰值区域呈现出蝴蝶对称性[20]且在每一列有峰值扩散现象,理想情况下应呈单峰形式,如图 4c所示(Hj为无单位的投票值)。而对于每一列在噪声干扰较大的地方则会出现多个极大值, 如图 4d所示。此时找到最大值的左侧第1个极小值点和右侧第一个极小值点,并保证是单峰的(即保留图 4d中的MN段),然后使用该列累加器值计算质心mi,还需对每一列的质心增加置信度评价,剔除低置信度的质心从而增加鲁棒性,可表示为:

$ \left\{\begin{aligned} C_i & =\frac{\sum\limits_{1 \leqslant j \leqslant h} H_{i j}}{\underset{1 \leqslant i \leqslant w}{\operatorname{argmax}}\left(\sum\limits_{1 \leqslant j \leqslant h} H_{i j}\right)} \\ M_i & =\left\{\begin{array}{l} 1, \left(C_i>T\right) \\ 0, (\text { otherwise }) \end{array}\right. \end{aligned}\right. $

(9) 式中,Ci为mi的置信度,$ \sum\limits_{1 \leqslant j \leqslant h} H_{i j}$表示求窗口内第i列的投票值之和,$\underset{1 \leqslant i \leqslant w}{\operatorname{argmax}}\left(\sum\limits_{1 \leqslant j \leqslant h} H_{i j}\right) $表示求窗口内某列累加器值总和最大的投票值,T为给定的掩模阈值,Mi为θi列的掩模。最后对整个区域求最大的连通域,图 4b经过自适应窗口策略处理后得到的掩模如图 5所示。

使用该掩模前和使用掩模后提取的峰值点如图 6a和图 6b所示。其中绿色点为每一列的质心mi,红色点为定位到的峰值点,图 6c和图 6d分别是其对应的每列方差曲线图。由图 6b可以看到,经过自适应窗口策略处理之后,定位到了准确的峰值点。

霍夫变换的计算效率与累加器的量化间隔和投票范围成倍数关系,为了减少不必要的计算,还设计了自适应范围投票策略:首先给定较大的粗量化间隔Δθmax(如1°)进行全角度范围内霍夫投票,对该霍夫空间直接求局部极大值作为峰值,得到一组峰值点集合Θ,然后使用下式得到局部投票范围:

$ \min (\varTheta)-\varepsilon<\theta<\max (\varTheta)+\varepsilon $

(10) 式中,ε是一个不为零的正整数,作用是为了扩展集合Θ的边界,使得之后的用较小的细量化间隔Δθmin投票时能够选择正确的直线参数。

最后基于霍夫变换的结构光场3维重建流程如图 7所示。首先将拍摄的图像序列提取成EPI,在EPI中的提取条纹中心坐标,然后根据自适应范围投票策略,使用粗量化间隔Δθmax进行霍夫投票得到投票范围,接着使用细量化间隔Δθmin进行霍夫投票,选取局部极大值作为初始峰值。在初始峰值处,基于自适应窗口策略提取准确的峰值直线参数(θpeak, ρpeak)。最后经过系统标定,根据(5)式得到物体的3维点云。

-

图 8是实验实物图。其中使用的工业相机是Basler公司出品的acA2440-75 μm,分辨率为2448 pixel×2048 pixel,单像素的物理尺寸为3.45 μm ×3.45 μm,配置长步道公司出品的25 mm焦距的镜头。主动投影光机的型号为Lightcrafter4500,分辨率是912 pixel×1140 pixel,以及一台沿着水平方向位移的电动平移台。

实验中选取一个灰太狼模型作为被测物体,从右至左在水平方向上采集了700张多线结构光图像序列,其中投影的多线结构光设计为10个像素间隔,包含91根直线。图 9a~图 9c是相机移动的位置s分别为1 mm、350 mm、700 mm时相机采集的原始图像。取图像中某一行数据的行坐标v=1500 pixel,将采集到的图像序列提取成EPI,如图 9d所示。

图 9 a—s=1 mm时的原始图像 b—s=350 mm时的原始图像 c—s=700 mm时的原始图像 d—v=1500 pixel时水平方向的EPI

Figure 9. a—original image at s=1 mm b—original image at s=350 mm c—original image at s=700 mm d—horizontal EPI at v=1500 pixel

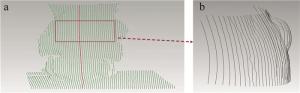

从图 9d可以看到,直线斜率变化比较明显的地方对应着物体的深度变化陡峭的地方,如果能正确求解这些直线参数,就能较好的恢复物体的3维信息。对所有EPI应用所提方法,将得到的点云数据导入Geomagic软件中,如图 10所示。图 10b为局部放大图,结果显示整体点云数据较为准确。

为了观察点云数据的平滑性,截取了竖直方向的点云轮廓线,如图 11所示。可以看到,轮廓线比较平滑,重建结果显示所提方法提取了准确的直线参数。

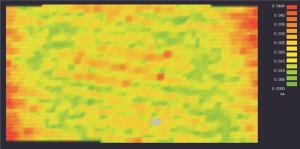

另外,通过测量一个平面来定量分析所提方法的测量精度,其中使用最小二乘法进行平面拟合并分析相关误差参数,如图 12所示。拟合的标准平面方程为: -0.0024X+0.0176Y+0.9998Z-0.1707=0,其中最大平面偏差为0.0564 mm,平均偏差为0.0096 mm,标准偏差为0.0074 mm。

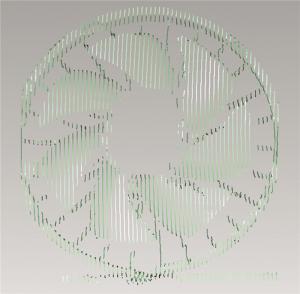

为了验证所提方法能够解决3维重建中的遮挡问题,选取了电风扇作为被测物体,由于电风扇罩网的存在,叶片在每个视角下都存在部分遮挡,普通基于结构光投影的3维测量方法很难完整地测量出叶片的形貌。而在本实验中,由于采用了结构光场测量系统,能够记录下不同视角的光场图像,从而完整地恢复了叶片形貌,如图 13所示。

然后对所有原图提取v=450 pixel时的EPI,如图 14所示。受电风扇外罩网遮挡的影响,不同视角下物体间的遮挡关系不一致,会导致EPI图像不连续的情况,但是基于霍夫变换算法则可以克服这种情况,准确地提取直线参数,从而完整地重建出叶片的形貌。

对所有EPI进行处理后,将得到的完整点云数据导入Geomagic软件中查看,结果如图 15所示。

该结果表明所提方法能够较为准确地恢复完整的叶片形貌,这使得可以通过一次扫描解决物体因遮挡而无法重建出完整3维形貌的问题。

-

本文中提出了一种基于霍夫变换的结构光场3维成像方法,该方法的系统结构简单、采集方便,投影方案灵活多变。在实验中,投影一幅多线结构光图案到被测物体表面构建匹配特征,利用光场成像中不同视角下物体的遮挡关系不一致,通过改进的霍夫变换提取被测物体的深度信息。实验结果表明,该方法能够准确地恢复被遮挡物体的完整表面形貌,而无需对投影的多线结构光图像进行条纹级次编码,灵活方便地获取3维数据。

基于霍夫变换的结构光场3维成像方法

Structured light field 3-D imaging method based on Hough transform

-

摘要: 为了在被测物体部分被遮挡的情况下, 仍能完整地测量出物体的表面形貌, 提出了一种基于霍夫变换的多线结构光标记的光场3维成像系统。通过提取亚像素的条纹中心坐标进行投票, 分析霍夫参数空间中的投票分布, 设计了自适应范围投票和自适应窗口策略, 无需对条纹级次编码也能够准确地确定对极平面图像中多根直线的参数。结果表明, 该系统拟合平面的平均偏差为0.0096 mm, 标准偏差为0.0074 mm, 并利用光场成像中不同视角下物体的遮挡关系不一致, 准确地恢复了被遮挡物体的完整表面形貌。这一结果对于解决3维测量过程中遮挡问题是有帮助的, 该研究为获取完整和高效3维数据的测量方法提供了参考。Abstract: In order to accurately recover the complete shape of the measured object with partial occlusion, a system for light field 3-D imaging based on multi-line structured light marking was proposed and a structured light field 3-D imaging method based on the Hough transform was proposed for the image processing problem in this system. The extracted sub-pixel fringe center coordinates were used to Hough transform, then the voting distribution in the Hough parameter space was analyzed, and adaptive range voting and adaptive window strategies were designed. Consequently, the parameters of multiple straight lines in the epipolar plane image can be accurately determined by the proposed method, which does not need to encode the fringe level. The experimental results show that the mean deviation and standard deviation of the fitted plane are 0.0096 mm and 0.0074 mm respectively. The complete shape of measured object is accurately obtained, which utilities the occlusion of different sub-aperture images is inconsistent in light field imaging. The result is helpful for solving the occlusion problem in the 3-D measurement process, and this work provides a reference for the measurement method to obtain complete and efficient 3-D data.

-

-

[1] ZHANG S. High-speed 3D shape measurement with structured light methods: A review[J]. Optics and Lasers in Engineering, 2018, 106: 119-131. [2] JAVIDI B, CARNICER A, ARAI J, et al. Roadmap on 3D integral imaging: Sensing, processing, and display[J]. Optics Express, 2020, 28(22): 32266-32293. doi: 10.1364/OE.402193 [3] MARRUGO A G, GAO F, ZHANG S. State-of-the-art active optical techniques for three-dimensional surface metrology: A review[J]. Journal of the Optical Society of America, 2020, 37(9): B60-B77. doi: 10.1364/JOSAA.398644 [4] LIU F, HOU G Q, SUN Zh N, et al. High quality depth map estimation of object surface from light-field images[J]. Neurocomputing, 2017, 252: 3-16. doi: 10.1016/j.neucom.2016.09.136 [5] TAO M W, SRINIVASAN P P, HADAP S, et al. Shape estimation from shading, defocus, and correspondence using light-field angular coherence[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 39(3): 546-560. [6] NG R. Digital light field photography[D]. San Francisco, USA: Stanford University, 2006: 19-36. [7] ZHOU W H, ZHOU E, LIU G M, et al. Unsupervised monocular depth estimation from light field image[J]. IEEE Transactions on I-mage Processing, 2019, 29: 1606-1617. [8] CAI Z W, LIU X L, PENG X, et al. Structured light field 3D imaging[J]. Optics Express, 2016, 24(18): 20324-20334. doi: 10.1364/OE.24.020324 [9] CAI Z W, LIU X L, PENG X, et al. Ray calibration and phase mapping for structured-light-field 3D reconstruction[J]. Optics Express, 2018, 26(6): 7598-7613. doi: 10.1364/OE.26.007598 [10] 刘顺涛, 骆华芬, 陈雪梅, 等. 结构光测量系统的标定方法综述[J]. 激光技术, 2015, 39(2): 252-258. LIU Sh T, LUO H F, CHEN X M, et al. Review of calibration method for structured light measurement[J]. Laser Technology, 2015, 39(2): 252-258(in Chinese). [11] 吴庆阳, 黄浩涛, 陈顺治, 等. 基于结构光标记的光场三维成像技术研究[J]. 红外与激光工程, 2020, 49(3): 255-260. WU Q Y, HUANG H T, CHEN Sh Zh, et al. Research on 3D imaging technology of light field based on structural light marker[J]. Infrared and Laser Engineering, 2020, 49(3): 255-260(in Chin-ese). [12] LEVOY M, HANRAHAN P. Light field rendering[C]//Proceedings of the 23rd Annual Conference on Computer Graphics and Interactive Techniques. New York, USA: Association for Computing Machinery, 1996: 31-42. [13] BOLLES R C, BAKER H H, MARIMONT D H. Epipolar-plane image analysis: An approach to determining structure from motion[J]. International Journal of Computer Vision, 1987, 1(1): 7-55. doi: 10.1007/BF00128525 [14] LU X T, WU Q Y, HUANG H T. Calibration based on ray-tracing for multi-line structured light projection system[J]. Optics Express, 2019, 27(24): 35884-35894. doi: 10.1364/OE.27.035884 [15] DUDA R O, HART P E. Use of the Hough transformation to detect lines and curves in pictures[J]. Communications of the ACM, 1972, 15(1): 11-15. doi: 10.1145/361237.361242 [16] 黄凌锋, 刘光东, 张超, 等. 基于灰度权重模型的激光条纹中心提取算法[J]. 激光技术, 2020, 44(2): 190-195. HUANG L F, LIU G D, ZHANG Ch, et al. Laser stripe center extraction algorithm based on gray weight model[J]. Laser Technology, 2020, 44(2): 190-195(in Chinese). [17] 吴庆阳, 苏显渝, 李景镇, 等. 一种新的线结构光光带中心提取算法[J]. 四川大学学报(工程科学版), 2007, 39(4): 151-155. WU Q Y, SU X Y, LI J Zh, et al. A new method for extracting the centre-line of line structure light-stripe[J]. Journal of Sichuan University(Engineering Science Edition), 2007, 39(4): 151-155. [18] NIBLACK W, PETKOVIC D. On improving the accuracy of the Hough transform[J]. Machine Vision and Applications, 1990, 3(2): 87-106. doi: 10.1007/BF01212193 [19] XU Z Zh, SHIN B S, KLETTE R. A statistical method for line segment detection[J]. Computer Vision and Image Understanding, 2015, 138: 61-73. [20] FURUKAWA Y, SHINAGAWA Y. Accurate and robust line segment extraction by analyzing distribution around peaks in Hough space[J]. Computer Vision and Image Understanding, 2003, 92(1): 1-25. -

网站地图

网站地图

下载:

下载: